ユースケース | CDC パイプライン

Confluent で Apache Flink® を使用して CDC パイプラインを構築

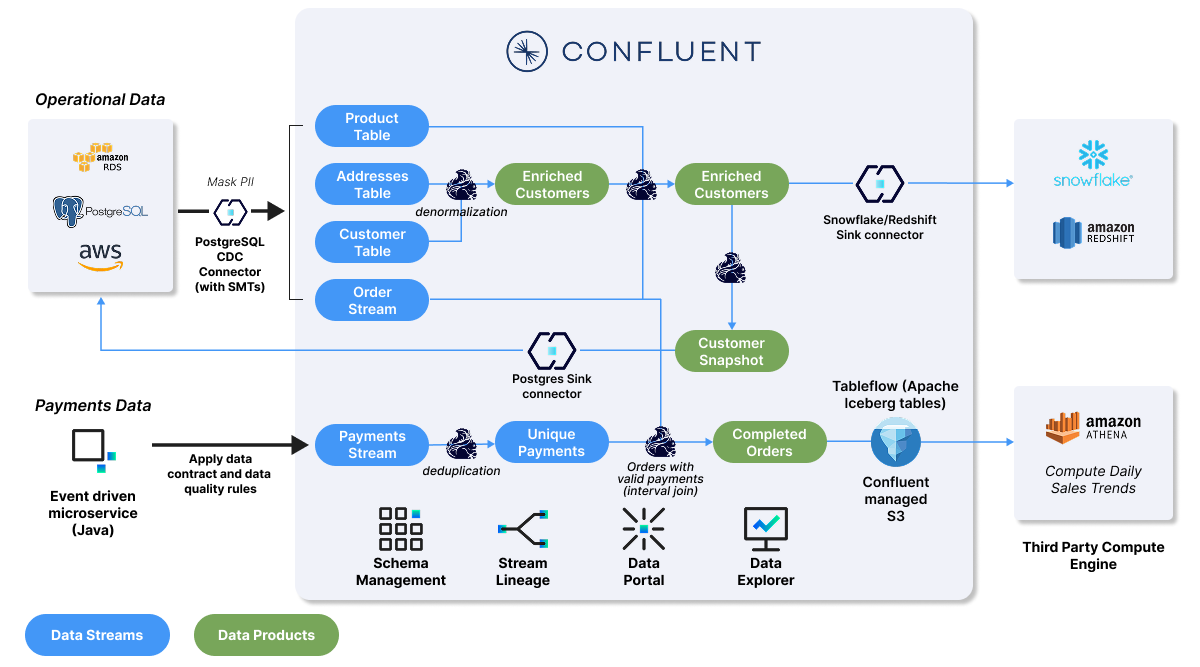

変更データキャプチャ (CDC) は、リレーショナルデータベース間でデータをコピーするために使用され、データ同期、移行、ディザスタリカバリなどの重要なバックエンド操作を可能にします。そして今、ストリーム処理を使用することで、従来のシステムと最新の分散システム全体に統合された最新の処理済みデータを活用し、イベントドリブン型アプリケーションや信頼できるデータ製品を支える CDC パイプラインを構築できるようになりました。Confluent が Apache Kafka® と Apache Flink® を組み合わせてストリーミング CDC パイプラインを構築し、最新の高品質な運用データでダウンストリーム分析を強化する方 法をご覧ください。

古いデータでの意思決定からリアルタイムでの対応へ

Go from making decisions on stale data to reacting in real time

処理コストを30%削減

Reduce your processing costs by 30%

手動の修正作業を行わずに、信頼できるクリーンなデータを提供

Deliver trusted, clean data without manual break-fix work

従来の CDC アーキテクチャにおける3つの主要な課題

ほとんどの組織はすでにログベースの CDC を使用して、データベースの変更をイベントに変換しています。- __バッチ処理による顕著なデータ遅延。__ほとんどの組織は、イベントストリームの代わりにバッチ処理を利用して、下流のログデータをマテリアライズします。つまり、次のバッチプロセスが実行されるまで、データシステムは数時間または数日間、同期されないままになります。- 冗長な処理のコスト。追加コストは、ポイントツーポイントの統合を構築・維持する必要があることと、これらのパイプライン全体で発生する冗長な処理の両方から生じます。- __絶え間ない手動の修理サイクルによる信頼の喪失。__これらすべてのパイプラインにわたって正確性を維持することは時間がかかり、人為的エラーが発生しやすいです。そしてこのアプローチは、下流の Consumer に影響を与える問題が発見されたときに初めて、チームに反応的に修正することを強いることになります。

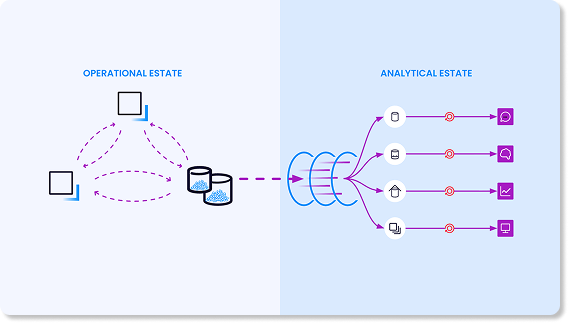

Kafka と Flink を使用して CDC パイプラインを構築すると、CDC ワークロードとバッチ分析を統合し、処理サイロを排除できます。このアーキテクチャでは、バッチ処理を待ったり、冗長な処理のコストを負担したり、脆弱なパイプラインに依存したりする代わりに、次のことが可能です。

- CDC データをイベントストリームとしてキャプチャする

- Flink を使用してこれらのストリームをリアルタイムで処理する

- 運用および分析の各領域で CDC ストリームを即座にマテリアライズする

わずかなコストでデータ価値を最大化

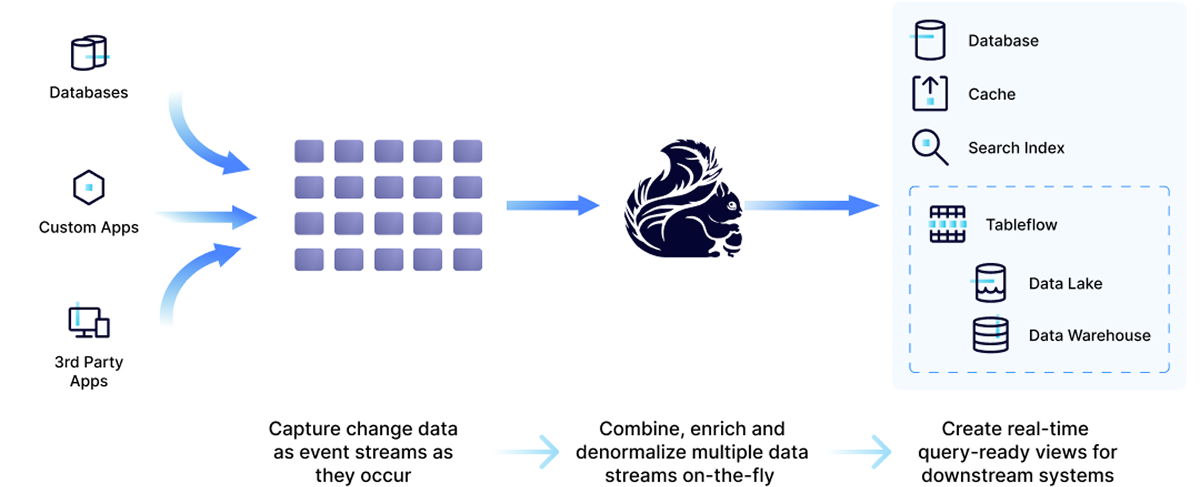

Confluent データストリーミングプラットフォーム上のサーバーレス Apache Flink® を使用すると、データ取り込み前に処理をシフトレフトして、レイテンシー、データの移植性、コスト効率を向上させることができます。- データ充実化: 追加のコンテキストを用いてデータを強化し、精度を向上します。- データの再利用性: アプリケーション間で一貫したデータストリームを共有します。- あらゆる場所にリアルタイム対応: 低遅延アプリケーションがイベントに即座に応答できるようにします。- __コスト削減:__リソースの使用を最適化し、冗長な処理を削減します。

アプリ開発チームはタイムリーなアクションを可能にするデータパイプラインを構築可能

分析のためのシフトレフトデータウェアハウスやデータレイクのインジェスト、リアルタイム検索インデックスの構築、ML パイプライン、SIEM の最適化など、どのようなニーズにも対応します。

分析チームは、計算、状態の更新、または外部アクションをトリガーすることで、イベントドリブン型アプリケーションに供給するためのデータを準備および整形できます。

コースの内容には、生成 AI ソリューション、詐欺検出、リアルタイムのアラートと通知、マーケティングのパーソナライズなどのために構築されたアプリケーションが含まれます。

Confluent ストリーム処理を使用して CDC パイプラインを構築するための3つのステップ

Confluent を使用すると、CDC ストリームを分析資産でマテリアライズする前に処理できます。Flink SQ を使用して、Kafka の Topics に取り込まれた変更データをフィルタリング、結合、充実化することができます。次に、運用資産と分析資産の両方にデータストリームをマテリアライズします。

ストリーミング CDC デモとケーススタディ

Confluent のお客様は Flink を使用して、データ同期やディザスタリカバリのような既存の CDC ユースケースを強化し、新しいリアルタイム機能を開拓しています。

GitHub リポジトリを調べて、Customer 360 や製品販売分析、または販売傾向分析のユースケースにおけるリアルタイム分析を実装する方法を学んでください。

選択できるラボは2つあります。

「CDC を導入したことで、リアルタイムデータの力を解き放ち、最終的にはバッチデータワークロードからストリーム処理へ移行することができました。」

「Flink を使用すると、データが Snowflake に到達する前にシフトレフトして、初期段階のデータ変換や計算を多数実行できるようになります。これにより、データ処理コストが最適化され、利用可能なデータの量が増えます。」

「Confluent による CDC 基盤の強化により、これまでは10分置きにバッチで取得していたデータをリアルタイムで得られるようになり、早期の不正検知が可能となりました。」

「一番大変だったのは、CDC とストリーミングプロセスを開発するための社内リソースが足りなかったことです。今では、CDC システムを簡単に構築できます。開発チームはストリーミングプロセスを開発する際の作業負荷を軽減できました。

「Confluent Cloud のおかげで、必要なチームに運用データをリアルタイムで提供できるようになりました。これは本当に強力で、運用上の負担を大幅に軽減します。」

Flink で CDC データをリアルタイムで処理する準備はできましたか?Confluent を使い始めて、あらゆる環境に対応したストリーム処理アーキテクチャを実装しましょう。

AWS、Google Cloud、Microsoft Azure で利用可能な Confluent Cloud for Apache Flink® をお試しください。サーバーレスでクラウドネイティブなコスト効率とシンプルさを活かして、Kafka + Flink を活用したアプリケーションを構築できます。Confluent Platform for Apache Flink® を使用することで、既存の Flink ワークロードを自己管理型のデータストリーミングプラットフォームに移行し、オンプレミスまたはプライベートクラウド に展開する準備が整います。

Confluent Cloud

完全マネージド型、クラウドネイティブの Apache Kafka® サービス

Streaming CDC With Flink | FAQs

How does a streaming approach improve on batch ELT/ETL pipelines?

A streaming approach allows you to "shift left," processing and governing data closer to the source. Instead of running separate, costly ELT jobs in multiple downstream systems, you process the data once in-stream with Flink to create a single, reusable, high-quality data product. This improves data quality, reduces overall processing costs and risks, and gets trustworthy data to your teams faster.

Why use Apache Flink® for processing real-time CDC Data?

Apache Flink® is the de facto standard for stateful stream processing, designed for high-performance, low-latency workloads—making it ideal for CDC. Its ability to handle stateful computations allows it to accurately interpret streams of inserts, updates, and deletes to maintain a correct, materialized view of data over time. Confluent offers a fully managed, serverless Flink service that removes the operational burden of self-management.

How do you handle data consistency and quality in real-time CDC pipeline?

Data consistency is maintained by processing CDC events in-flight to filter duplicates, join streams for enrichment, and aggregate data correctly before it reaches any downstream system. Confluent's platform integrates Flink with Stream Governance, including Schema Registry, to define and enforce universal data standards, ensuring data compatibility, quality, and lineage tracking across your organization.

How does Confluent Cloud handle changes to the source database schema?

When your CDC pipeline is integrated with Confluent Schema Registry, it can automatically and safely handle schema evolution. This ensures that changes to the source table structure—like adding or removing columns—do not break downstream applications or data integrity. The platform manages schema compatibility, allowing your data streams to evolve seamlessly.

What are the main benefits of using a Fully managed service for Apache Flink® like Confluent Cloud?

A fully managed service eliminates the significant operational complexity, steep learning curve, and high in-house support costs associated with self-managing Apache Flink®. With Confluent, you get a serverless experience with elastic scalability, automated updates, and pay-as-you-go pricing, allowing your developers to focus on building applications rather than managing infrastructure. In addition, native integration between Apache Kafka® and Apache Flink® and pre-built connectors allow teams to build and scale fast.

How does Confluent Cloud simplify processing Debezium CDC events?

Confluent Cloud provides first-class support for Debezium, an open source distributed platform for change data capture. Pre-built connectors can automatically interpret the complex structure of Debezium CDC event streams, simplifying the process of integrating with Kafka and Flink.