Apache Kafka®️ 비용 절감 방법 및 최적의 비용 설계 안내 웨비나 | 자세히 알아보려면 지금 등록하세요

120종 이상의 사전 구축 커넥터

비즈니스 전체를 더 빠르게 연결

모든 데이터 소스 또는 싱크에 대해 120종 이상의 사전 구축 커넥터를 통해 데이터 사일로 격파

커넥터당 3~6개월의 개발 시간을 절약합니다.

커넥터당 3~6개월의 개발 시간을 절약합니다.

레거시 및 클라우드 시스템을 연결하여 기술 스택을 현대화합니다.

레거시 및 클라우드 시스템을 연결하여 기술 스택을 현대화합니다.

완전 관리형 커넥터를 통해 운영 부담, 위험, TCO를 줄입니다.

완전 관리형 커넥터를 통해 운영 부담, 위험, TCO를 줄입니다.

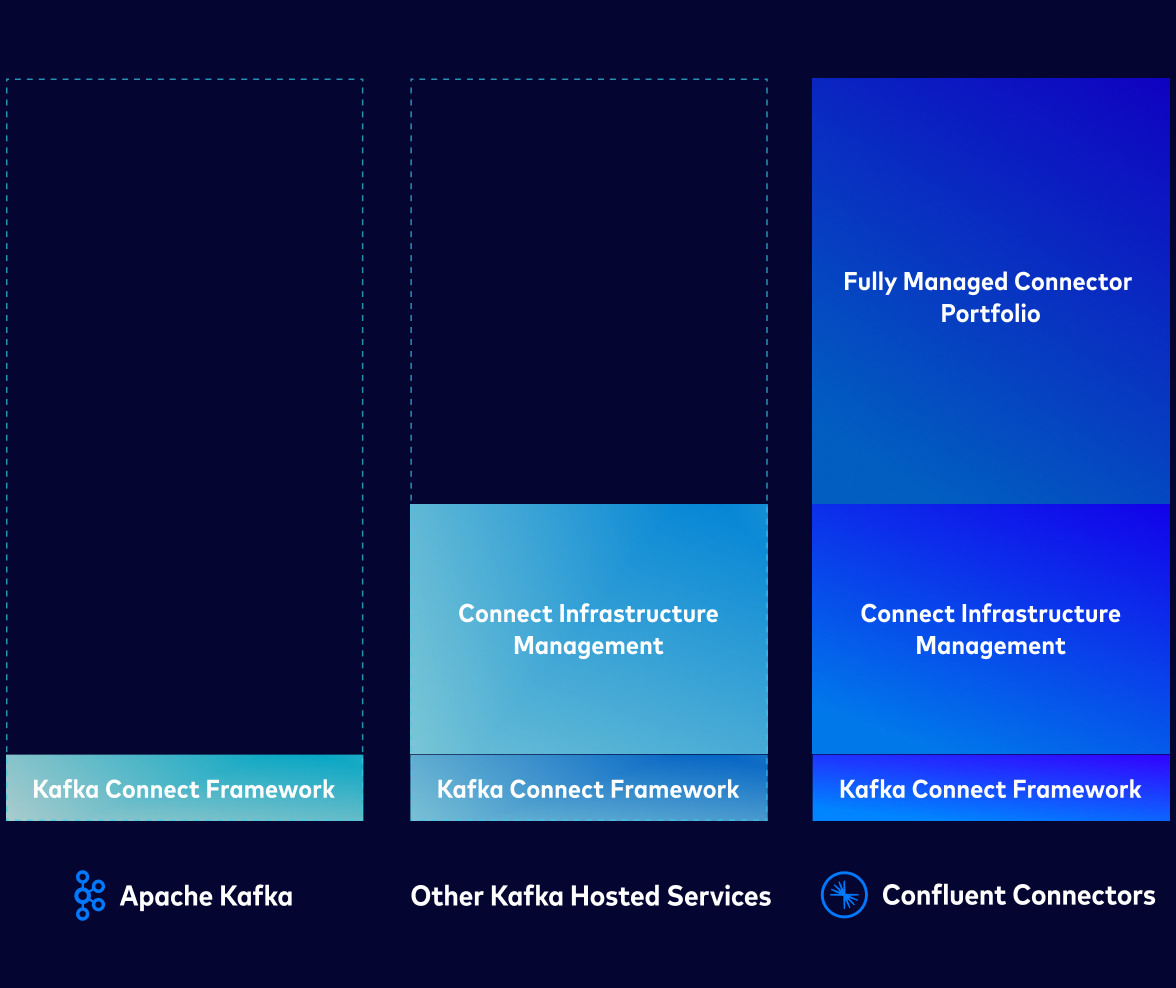

Kafka Connect는 Apache Kafka®와 데이터를 통합하기 위한 개방형 표준입니다.

Confluent는 120종 이상의 사전 구축 커넥터로 구성된 업계 최대 규모의 포트폴리오를 통해 Kafka Connect를 한 단계 더 발전시키고 엔터프라이즈급 보안, 신뢰성, 지원을 통해 운영 부담과 위험을 제거합니다.

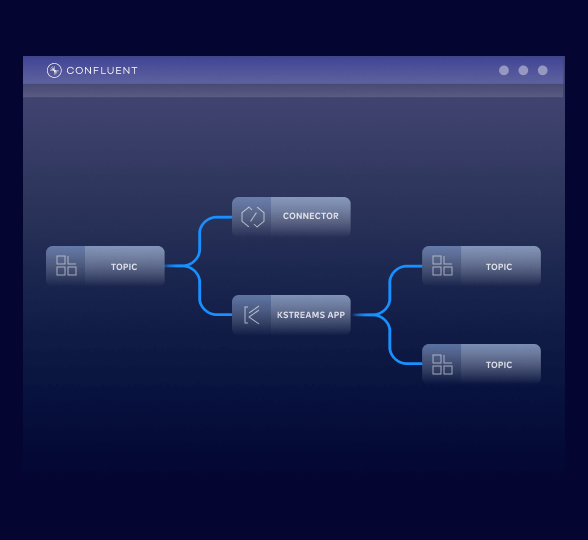

코드 없이 데이터 통합하기

팀원들을 일반적인 통합 코드 작성과 커넥터 관리 업무에서 해방시키세요.

구성 파일, UI 또는 API를 통해 프라이빗 네트워크에서 커넥터를 정의하고 소스와 싱크를 식별하며 스트리밍을 시작하시면 됩니다.

Confluent는 120개가 넘는 통합을 제공합니다.

사전 구축된 커넥터

각 커넥터를 설계, 구축 및 테스트하는 데 소요되는 3~6개월의 엔지니어링 시간을 절약합니다.

완전 관리형 커넥터

운영 오버헤드 없이 몇 분 만에 시작하여 총소유비용을 절감할 수 있습니다.

맞춤형 커넥터

맞춤형 앱용 커넥터를 직접 가져와서 Connect 인프라를 관리합니다.

엔터프라이즈급 보안 및 지원

프라이빗 네트워킹, 99.99% 가동 시간 SLA, RBAC 및 전문가 지원으로 미션 크리티컬 워크로드를 강화합니다.

기술 스택 현대화

커넥터를 사용하여 레거시 시스템과 최신 클라우드 기술을 연결하는 데이터 스트리밍 파이프라인을 쉽게 구축할 수 있습니다.

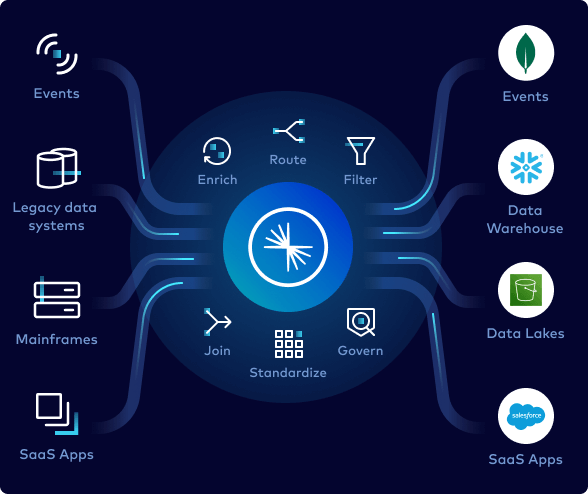

Confluent의 커넥터는 다음과 같습니다:

데이터베이스

CDC 커넥터를 사용하여 레거시 데이터베이스에서 클라우드 네이티브 데이터베이스로 마이그레이션을 가속화하고 위험을 줄입니다.

데이터 웨어하우스

실시간 데이터를 클라우드 데이터 웨어하우스로 스트리밍하여 데이터 팀이 최신 정보로 작업할 수 있도록 지원합니다.

데이터 레이크

데이터 소스와 싱크를 분리하여 데이터 아키텍처를 간소화하고 데이터 레이크를 채웁니다.

SaaS 앱

모든 SaaS 앱을 연결하여 비즈니스의 모든 부분에서 데이터를 사용할 수 있도록 합니다.

Day 2 운영 간소화

Confluent는 귀하의 환경 전반에 걸쳐 광범위한 제어 및 가시성을 제공합니다.

그러면 워크플로가 이렇게 간소화됩니다.

AWS IAM AssumeRole

임시 자격 증명을 사용하여 조직 전체에서 AWS 리소스 접근 권한을 쉽고 안전하게 관리합니다.

즉각적인 구성 검증

필드 입력에 대한 피드백과 오류 알림을 받아 커넥터를 성공적으로 실행합니다.

클라이언트 측 필드 수준 암호화

커넥터 안에서 레코드 암호화 및 복호화를 활성화하여 매우 민감한 워크로드를 지원합니다.

맞춤형 단일 메시지 변환

스트림 처리 전에 소스나 싱크 커넥터 내에서 마스킹과 필터링 같은 가벼운 데이터 변환을 수행합니다.

로그 및 지표 모니터

컨텍스트 정보와 오류 디버깅을 위해 콘솔에서 커넥터 이벤트를 확인합니다.

"강력한 완전 관리형 커넥터를 사용하여 Amazon S3와 같은 대상으로 데이터를 손쉽게 스트리밍함으로써 실시간 이벤트 로깅을 확장 가능하고 효율적으로 만듭니다... Confluent에는 사전 구축된 방대한 커넥터 라이브러리가 있어 최종 경로를 결정하기 전에 신속하게 프로토타입을 제작할 수 있습니다."

EVO Banco는 사실상 무제한의 커넥터를 통해 광범위한 데이터 소스에 접근할 수 있었습니다. 구성은 간단했습니다. 필요한 데이터 소스 유형을 지정하고 연결 세부 정보를 제공하기만 하면 됩니다. 이러한 방식으로 회사는 데이터를 즉시, 수월하게 전송하기 시작할 수 있었습니다.

"Confluent 완전 관리형 커넥터를 사용하면 혁신 속도를 높일 수 있습니다... 공통 데이터 소스에 대한 통합을 수정하는 대신 새로운 기능을 개발하는 데 소중한 자원을 실제로 투자할 수 있습니다."

신규 개발자는 첫 30일 동안 $400 상당의 크레딧을 받습니다(영업 담당자 불필요).

Confluent가 다음에 필요한 모든 것을 제공합니다.

- Java, Python 같은 언어를 위한 클라이언트 라이브러리, 샘플 코드, 120개 이상의 사전 구축된 커넥터, Visual Studio Code 확장 프로그램을 사용하여 빌드

- 주문형 학습과정, 증명서, 글로벌 전문가 커뮤니티에서 학습

- CLI, Terraform 및 Pulumi에 대한 IaC 지원, OpenTelemetry 관측 가능성을 가지고 운영

아래에서 클라우드 마켓플레이스 계정으로 가입하거나 Confluent에 직접 가입하세요.

Confluent Cloud

Apache Kafka®를 위한<br />클라우드-네이티브 서비스

Confluent Connectors | FAQS

Can I modernize legacy systems with Confluent connectors?

Confluent offers a portfolio of more than 120 pre-built, enterprise grade connectors that make it easy for you to connect external systems to your Kafka deployments. By taking advantage of these connectors, you no longer have to write, test, and maintain integration code just to get your data into and out of Kafka topics.

That means you can easily modernize legacy systems with Confluent—easily connect your legacy databases, mainframes, and messaging systems to cloud data services and platforms with Confluent as your intermediary data access layer.

What makes Confluent-managed connectors different from open source Kafka Connect?

Confluent offers 80+ fully managed connectors, which means that you don’t have to manage connector plugins or their underlying infrastructure and can offload provisioning, upgrades, and patching.

Confluent-managed connectors eliminate integration overhead for your Kafka deployments and come with a 99.99% uptime SLA for production workloads. As a result, using these connectors frees your engineering teams from the burden of managing integration code and infrastructure. Instead, your teams can focus on building applications and unlocking the value of your data.

Other key operational benefits include:

- Seamless Upgrades: Features like plugin versioning for custom connectors allow for smooth upgrades without losing offsets or disrupting service.

- Improved Troubleshooting: Non-admin roles can now access connector logs, empowering them to manage and diagnose their own connectors without escalating to an administrator.

- Less Maintenance: Confluent manages all the underlying infrastructure so your team doesn't have to worry about provisioning, patching, or scaling the Connect environment.

How do Confluent connectors help reduce total cost of ownership (TCO)?

Confluent's fully managed connectors help lower your Kafka TCO by eliminating the costs associated with building and maintaining the integration code in connector plugins and from self-managing a Kafka Connect environment.

Key savings come from:

- Cost-Efficient Infrastructure Scaling: Elastic scaling for all Confluent connectors and autoscaling with fully managed connectors enables you to scale and consume compute resources more efficiently.

- Reduced Operational Burden: With fully managed connectors, you save on the engineering time and resources needed for maintenance, troubleshooting, and upgrades. High-availability reduces the business impact of unplanned pipeline downtime.

- Increased Developer Productivity: With simplified, secure streaming integration, your developer teams spend less time blocked by data access issues and can dedicate more resources to building real-time applications and event-driven systems across the organization. And using pre-built connectors can help cut 3-6 months from your production timelines.

How does Confluent’s price guarantee apply to connectors?

Confluent will beat or match the price of Kafka services from your hyperscaler, allowing you to save money on your streaming workloads—including when it comes to your Connect tasks.

Visit the Confluent Cost Estimator to see how much you can save as you scale seamlessly and cost-effectively with Confluent. Explore the volume-based discounts that you can access for Connect tasks with annual commitments for Confluent Cloud.

What security and compliance features are available for sensitive data?

Confluent connectors are built with enterprise-grade features for security, reliability, and developer productivity including secure private networking configurations, built in single message transforms (SMTs), and more.

Confluent helps ensure that the streaming data pipelines you build are secure and compliance, with purpose-built features for handling sensitive data:

- Granular Access Control: Enhanced role-based access control (RBAC) allows you to grant users the specific permissions they need to manage connectors without giving them full admin rights.

- Secure Networking: You can connect to data systems in private networks using features like DNS Forwarding and Egress PrivateLink, restricting traffic from the public internet.

- Data Masking: You can use single-message transforms (SMTs) to perform lightweight transformations on connector workloads, including masking sensitive data field within a data stream.

- Data Encryption: Specific connectors, like the one for Oracle XStream, support client-side field level encryption (CSFLE) to ensure data remains secure continuously.

- Advanced Authentication: Many connectors support modern, secure authentication methods like AWS IAM AssumeRole, which removes the need for long-lived access keys. Others support protocols like OAuth2 and SSO integration.

How quickly can I launch a connector in Confluent Cloud?

You can launch fully managed connectors in seconds with no-code provisioning and real-time configuration checks, Simply find the fully managed connector you need on Confluent Cloud and hit launch or access them directly from your Confluent Cloud account.

Self-managed connectors require more initial setup to run alongside your cloud deployment. Search Confluent Hub to find self-managed Confluent, partner, and community-built connectors and then visit Docs to learn how to connect self-managed Kafka Connect to Confluent Cloud.

Do I need to browse the Connector Hub to get started?

While you don't need to browse Confluent Hub to get started, it is a great way to see all the options available for your self-managed and fully managed Kafka deployments. The Hub helps you discover what integrations are available via Confluent, as well as find open source and partner-verified connectors beyond the 120+ that we offer.

If you’re looking specifically for fully managed connectors to use on AWS, Microsoft Azure, or Google Cloud, you can log in to the Cloud Console and launch connectors in just a few clicks.

Can I bring my own custom connector to Confluent Cloud?

Yes, you can bring your custom and in-house built connectors to Confluent Cloud. The platform now supports plugin versioning for custom connectors, which allows you to upload a new version of your plugin and seamlessly direct active connectors to it, resuming from the last offset. This is managed through the new Custom Connect Plugin Management (CCPM) APIs.

How do Confluent connectors support real-time AI and analytics initiatives?

Confluent connectors are the foundational layer for real-time AI and analytics, as they feed live data streams from across your business into the platforms where this analysis occurs. Capture changes as they happen from databases like PostgreSQL and Oracle using Confluent’s CDC connectors.

Then, stream the real-time events needed for AI/ML models and analytics dashboards to understand and act on the state of the business. Combined with sink connectors for major analytics and data warehouse platforms—such as Snowflake and Amazon Redshift—this allows you to stream processed, enriched data directly into these systems for immediate use. This ability to build real-time pipelines is essential for unlocking new AI and analytics use cases.